生成AIでエッチな画像を作る探求

画像からポーズを取得するにあたり、どのプリプロセッサーが良いのか比較しようと思ったのですが、その前にDensePose Preprocessorというものがあることを知りました。

これはOpenposeやDepthとはまた違ったものなのですが、どのように使うのか、どういった結果になるのか試してみたいと思います。

DensePoseとは

DensePoseは、入力画像の中の人間の各ピクセルが「3D人体モデルのどの位置に対応しているか」を推定して、体表を色分けマップとして出力する技術です。

これにより、ポーズだけでなく体の向きや立体感まで把握でき、ControlNetなどで人物のポーズ・形状を高精度に制御するためのヒント画像として利用されます。

使い方

プリプロセッサーはすでにあるので、抽出した画像を使うためのモデルをダウンロードします。以下のURLから、controlnet-densepose-1.5.safetensorsをダウンロードします。

ダウンロードしたモデルをData > Models > CotrolNetに配置します。

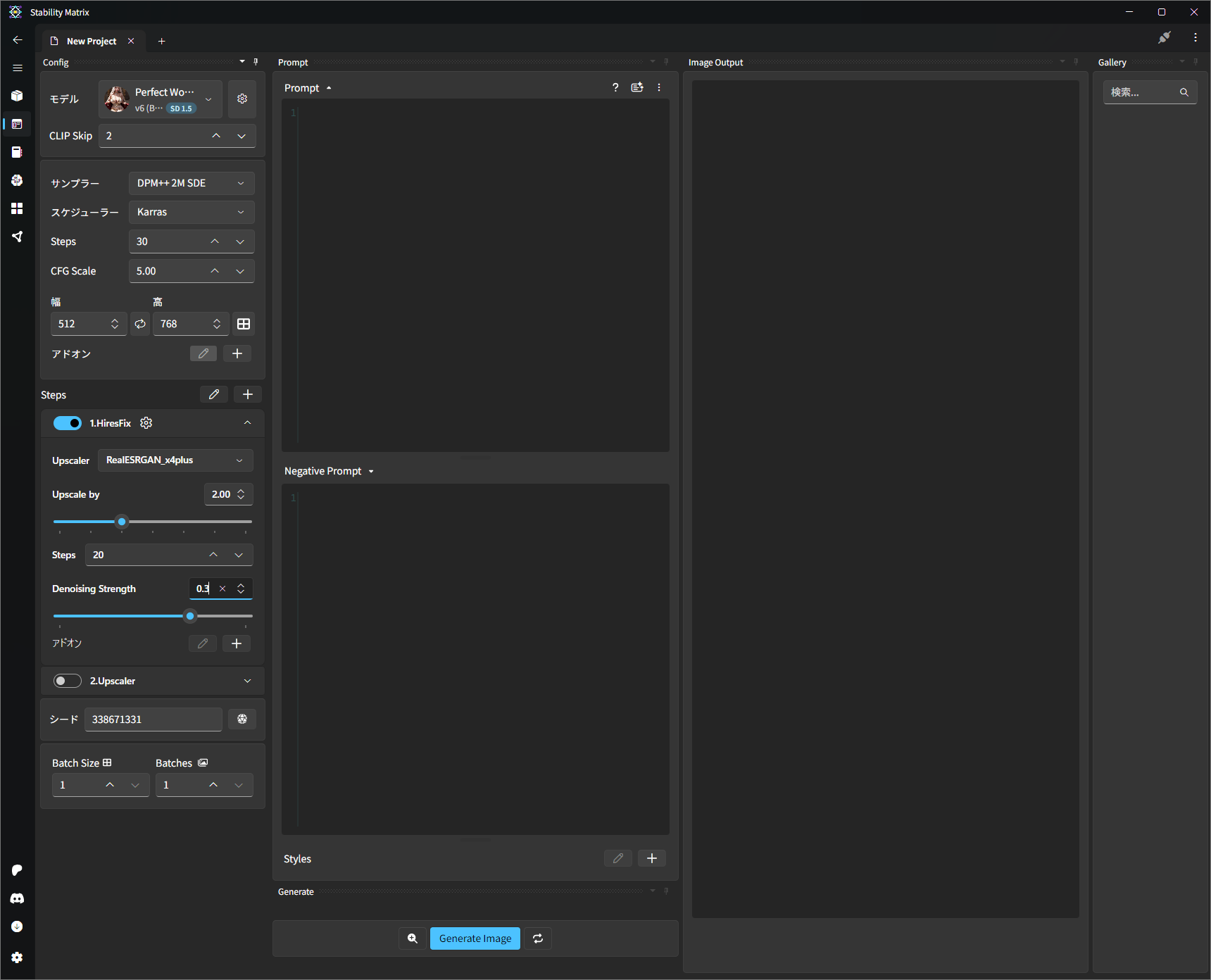

配置後、Inferenceを開き、設定をしていきます。

- モデル:Perfect World 完美世界

- CLIP Skip:2

- サンプラー:DPM++2M SDE

- スケジューラー:Karras

- Steps:30

- CFG Scale:5.00

- サイズ:512 x 768 または 768 x 512

- HiresFix:オン

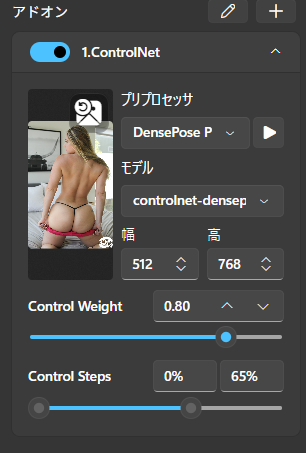

次に、ControlNetを有効にしポーズを抽出する画像とプリプロセッサー、モデルなどを設定していきます。

- プリプロセッサ:DensePose Preprocessor

- モデル:controlnet-densepose-1.5

- サイズ:512 x 768 または 768 x 512

- Control Weight:0.80

- Control Steps:0-65%

設定できましたら画像を生成します。

実行結果

例1

一応、なくとも後ろを向きますがfrom behindを追加

例2

例3

kneeing, from behindを追加

まとめ

ちょっと使ってみた感想ですが、OpenposeとDepthを一緒にして強度を弱めた感じかな。という印象を受けました。

ポーズ元とした画像の画質が悪いため、イマイチな結果になった可能性もあります。また、生成に使ったモデルがSD1.5系なのでSDXL以降のモデルにすると結果が変わる可能性もあります。もう少し試してみたいと思います。

コメント